Uno scontro tra puristi e tecnologia nella musica giamaicana

Nelle feste in cui i dj si sfidano con canzoni reinterpretate è arrivata l’intelligenza artificiale, e non tutti l’hanno presa bene

A luglio a Montego Bay, in Giamaica, c’è stata la 31esima edizione del Sumfest Global Sound Clash, un festival annuale in cui gruppi di dj chiamati “sound system” – espressione che viene spesso usata per indicare, più nello specifico, l’impianto audio che usano – competono tra loro per dare sfoggio della loro abilità tecnica e ottenere l’approvazione del pubblico in apposite gare, chiamate “sound clash”. Uno dei momenti più attesi di queste gare è la presentazione dei cosiddetti “dubplate”, ossia delle cover di canzoni molto famose reinterpretate in chiave reggae e dancehall, e che solitamente vengono realizzate per essere riprodotte una sola volta: durante un sound clash, per l’appunto.

Tutti i dubplate prevedono dei featuring, ossia partecipazioni di cantanti (spesso quelli che hanno scritto la canzone che si intende reinterpretare) o personaggi famosi che prestano la loro voce per realizzare dei campionamenti originali da inserire in un determinato momento della traccia: possono essere nuove strofe scritte per l’occasione, battute o più semplicemente degli skit, ossia delle parti parlate.

Le gare di sound clash prevedono che i dj rispettino una serie di regole non scritte nella realizzazione di un dubplate: una delle più importanti è che ogni sound system debba ottenere il proprio featuring in modo professionale, e quindi contattando il cantante di turno, facendogli scrivere la strofa originale da utilizzare per l’occasione e infine retribuendolo, accettando di pagare delle cifre che a volte possono essere piuttosto esose. Nella cultura dei sound clash, ottenere la collaborazione di un cantante con queste modalità è uno dei modi che consentono di guadagnare stima e credibilità nell’ambiente.

Negli ultimi anni però alcuni dj hanno iniziato a violare questa consuetudine e a utilizzare dei trucchi per facilitarsi il lavoro: quello più comune, e particolarmente detestato dai dj che vivono queste competizioni con una certa integrità, è utilizzare dei software di intelligenza artificiale per riprodurre delle voci simili a quelle del cantante che si vorrebbe inserire nella propria registrazione.

Per esempio, durante l’ultima edizione del Sumfest, il sound system giamaicano dei Bodyguard ha usato questo metodo per ricreare la voce di Donald Trump e inserirla in un dubplate: alcuni colleghi sono rimasti stupiti dalla scelta, specialmente quelli che partecipano a eventi di questo tipo dalla fine degli anni Ottanta, quando l’originalità e l’autenticità delle composizioni era considerata un principio quasi sacro nell’ambiente.

Courtney Singh, il fondatore dei Bodyguard, ha detto che dal suo punto di vista l’utilizzo della voce di Trump non è una contravvenzione delle regole dei sound clash, dato che si tratta di una registrazione di pochissimi secondi e utilizzata per uno scopo parodistico e non competitivo. Tuttavia, anche dal suo punto di vista un eventuale sdoganamento dell’intelligenza artificiale potrebbe essere un problema. «È un pericolo reale, non so come verrà controllato. C’è un codice etico non detto in queste gare, ma ora sta prendendo piede una generazione diversa che punta a vincere a tutti i costi».

La cultura dei sound clash prese piede in Giamaica negli anni Cinquanta, quando i primi sound system giamaicani (come Tom the Great Sebastian e Duke Reid the Trojan) cominciarono a scontrarsi in gare clandestine nelle periferie di città come Kingston e Montego Bay.

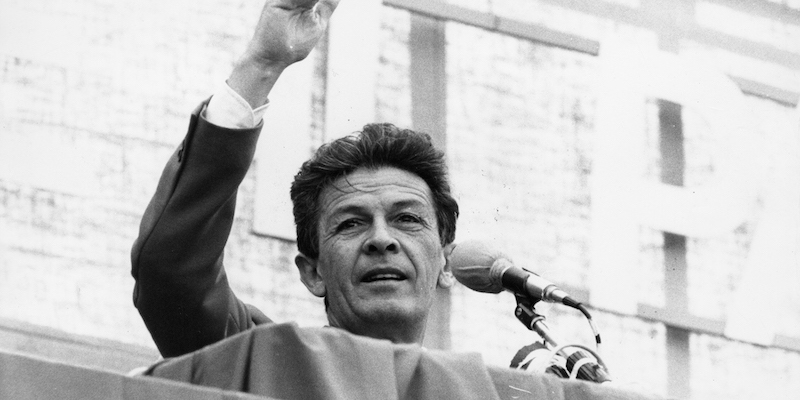

Tra gli anni Settanta e Ottanta queste gare cominciarono a diffondersi anche in Europa, e in particolare in Inghilterra, dove diventarono una parte integrante della cultura delle comunità giamaicane di seconda generazione. Uno dei modi più immediati per capire come funziona questa sottocultura è probabilmente la visione di Babylon, film del 1980 diretto dal regista italiano Franco Rosso che racconta la storia di un sound system di giamaicani emigrati a Londra chiamato Ital Lion.

Diversi dj con una lunga storia di partecipazioni a gare di sound clash sostengono che, nel lungo termine, l’impiego dell’intelligenza artificiale possa far scomparire la sottocultura in cui sono cresciuti, o quantomeno trasformarla in qualcosa di più posticcio e meno autentico. «Non si tratta semplicemente di usare una voce, ma di come l’hai ottenuta e di quanto hai pagato per averla» ha raccontato al Guardian il dj britannico Paul Scott Levy, detto anche General Levy, parlando della sua predilezione per i dubplate realizzati in modo tradizionale.

A questo proposito, Levy ha citato come esempio di cattivo utilizzo dell’intelligenza artificiale il recente beef (semplificando, una battaglia in cui due rapper si sfidano con dei dissing, cioè canzoni scritte appositamente per insultarsi e prendersi in giro in rima) tra Kendrick Lamar e Drake, due dei rapper più famosi al mondo. In quell’occasione Drake aveva fatto una canzone, “Taylor Made Freestyle”, in cui era stata inserita una strofa cantata da una voce sintetizzata molto simile a quella di Tupac, creata utilizzando l’intelligenza artificiale, circostanza che aveva spinto gli eredi del rapper a fare causa a Drake.

– Leggi anche: Nell’hip hop i “dissing” possono ancora monopolizzare il dibattito

Anche Notorious International, uno dei sound system che hanno partecipato al Sumfest di luglio, è contrario all’impiego dell’intelligenza artificiale durante le gare. Hanno partecipato all’edizione di quest’anno presentando un dubplate di “Buffalo Soldier” di Bob Marley, intitolato “Japanese Soldier”, e per farlo hanno pagato regolarmente un cantante per registrare da zero le nuove parti vocali da inserire nella traccia. Bad Gyal Marie, una delle dj di Notorious International, ha detto che il gruppo ha preso questa decisione perché avrebbe trovato quasi sacrilego rielaborare artificialmente la voce di Marley: «È per rispettare l’artista. Se la gente vuole farlo lo faccia, al massimo li scoprirò e li insulterò».

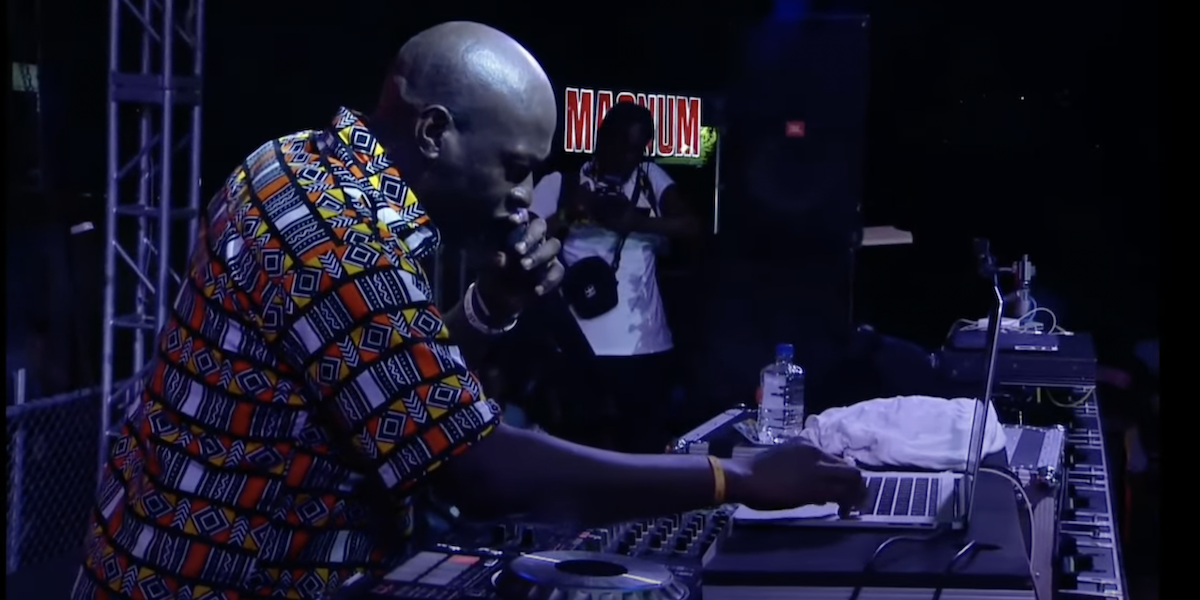

Non tutti i dj che partecipano a gare di sound clash hanno una visione così categorica. Per esempio il dj sudsudanese Dynamq ha raccontato che, pur non ricorrendo a metodi di questo tipo, dal suo punto di vista l’utilizzo di software di intelligenza artificiale non rappresenta un grosso problema, dato che con il passare degli anni questa pratica sarà sempre più sdoganata.

Inoltre, ha aggiunto Dynamq, lo scopo principale di queste gare rimane comunque quello di far ballare e divertire la gente con soluzioni di missaggio originali, e «non credo che al pubblico importi qualcosa [dell’intelligenza artificiale]. Finché suona bene, la gente ci andrà dietro».

– Leggi anche: Il rap che si improvvisa

Fabian Anderson, un intermediario che per lavoro si occupa di mettere in contatto dj e cantanti per la realizzazione dei featuring, ha detto che l’intelligenza artificiale sta «sconvolgendo» le gare di sound clash. A seconda dei casi, ottenere un featuring può essere relativamente economico o molto costoso: Anderson ha detto che nella maggior parte dei casi le collaborazioni costano tra i 130 e i 750 euro, ma che quelle con i cantanti più richiesti possono costare anche alcune migliaia di euro.

Sempre secondo Anderson, realizzare un dubplate in modo tradizionale è anche un modo per assicurarsi il suo successo. Infatti, anche se sono concepite come registrazioni uniche da riprodurre una sola volta, ossia durante un sound clash, alcuni dubplate sono così ben riusciti da diventare canzoni di successo. Da questo punto di vista, il caso più famoso è probabilmente quello della cover di “Killing Me Softly with His Song” realizzata dal gruppo hip hop statunitense dei Fugees, che fu presentata la prima volta come dubplate durante un sound clash con il titolo di “Killing Me Softly with his Sound”.