I CAPTCHA stanno effettivamente diventando più difficili, e sarà sempre peggio

Il progredire dei software di intelligenza artificiale, tra le molte cose, fa sì che sarà sempre più difficile distinguere gli umani dai bot

Per anni i CAPTCHA, ovvero i test di sicurezza usati per determinare se a voler svolgere una certa azione online sia un essere umano o un computer, sono stati piuttosto ripetitivi. C’erano quelli che chiedevano di riconoscere numeri o lettere scritte in ordine casuale, o una serie di immagini contenenti palme o lampioni, o ancora quelli che semplicemente volevano che l’utente cliccasse su un quadratino di lato alla scritta “Non sono un robot”. Nonostante la loro relativa semplicità, i CAPTCHA sono sempre stati antipatici a molti utenti di internet, che li trovano di solito fastidiosi e che non apprezzano l’interruzione anche solo momentanea della loro esperienza online.

Da qualche mese, però, a questa insofferenza di fondo si sta aggiungendo un’ulteriore frustrazione dovuta al fatto che i CAPTCHA stanno diventando sempre più strani, enigmatici e difficili da risolvere. Non è soltanto un’impressione: per far fronte al progressivo sviluppo delle cosiddette “intelligenze artificiali”, software avanzati che tra le altre cose sono capaci di riconoscere immagini e parole con una precisione molto superiore a quella del passato, chi progetta i CAPTCHA si sta ingegnando per ideare test che siano semplici per gli esseri umani ma non per i bot. Con un successo finora altalenante.

CAPTCHA è un acronimo imperfetto che sta per Completely Automated Public Turing (test to tell) Computers (and) Humans Apart, “un test di Turing completamente pubblico e automatico per distinguere i computer dagli umani”. Al contrario del test di Turing, che si propone di misurare la capacità di una macchina di rispondere a certe domande come farebbe un essere umano, i CAPTCHA provano a “individuare esseri umani”, ovvero a escludere che dietro a un determinato comportamento online ci sia un programma automatizzato (i cosiddetti bot). Questi sistemi servono quindi soprattutto per evitare che i bot utilizzino determinati servizi: sono usati per esempio per assicurarsi che siano soltanto esseri umani a comprare i biglietti per un concerto molto richiesto, oppure che non siano dei software a commentare sotto al post di un blog o a registrarsi su un sito web.

Con l’avanzare degli sviluppi tecnologici, però, questo lavoro è diventato più difficile. «I software sono diventati particolarmente bravi a riconoscere le foto. È per questo che stiamo lavorando a una nuova ondata di CAPTCHA che si basino invece sulla logica», ha spiegato Kevin Gosschalk, fondatore di Arkose Labs, l’azienda che sta dietro ad alcuni dei test più strani e difficili che si trovano online.

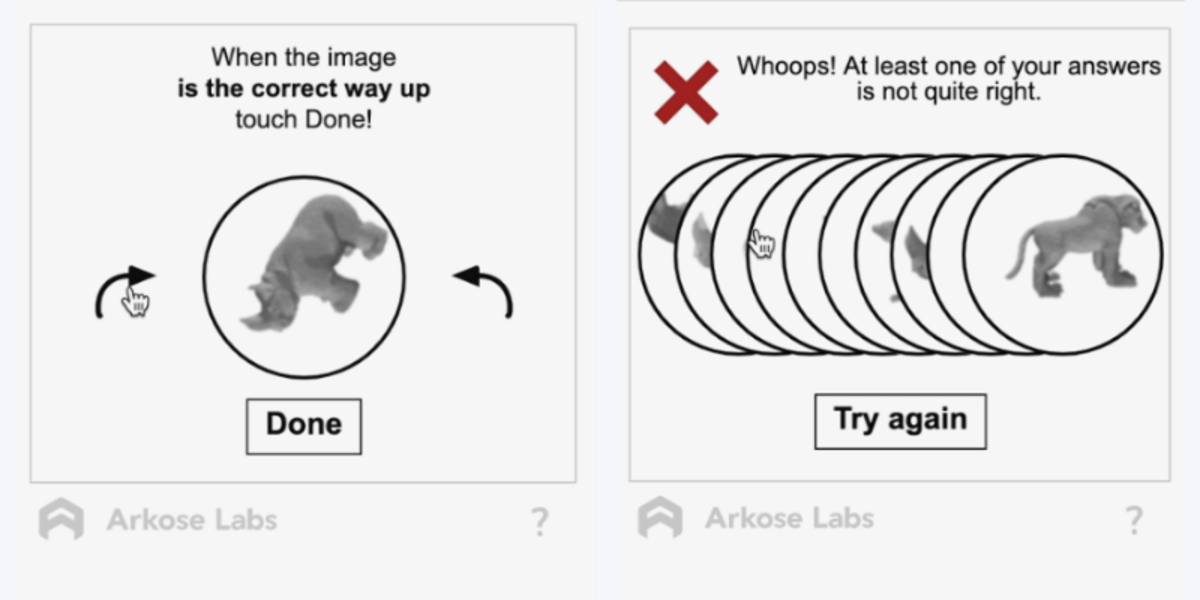

Sono di Arkose Labs, per esempio, i CAPTCHA che chiedono all’utente di capovolgere con il mouse o con il dito il disegno di un animale, oppure di cliccare sull’immagine di un animale che NON vive sott’acqua, o ancora di selezionare due oggetti che hanno la stessa forma. «Gli utenti non possono più semplicemente identificare semplici oggetti», spiega insomma la giornalista Katie Deighton. «Devono identificare un oggetto e poi fare qualcosa con quell’informazione: muovere un pezzo di un puzzle, ruotare un oggetto, trovare un numero nascosto in un’immagine più ampia».

@kelonwashere Captchas are legit the worst. I was just tryna look at TikTok videos fam 😭😭 #funnyvideo #comedy #fypシ #fyp ♬ original sound – Kel

Nessuna di queste cose è davvero difficile in sé, ma è senza dubbio più difficile dei CAPTCHA tradizionali, impegna più tempo e può essere faticosa da interpretare per qualcuno che va di fretta o che ha qualche disturbo legato alla sfera dell’apprendimento. I CAPTCHA, però, dovrebbero andare bene per qualunque umano si trovi a usarli, di qualsiasi età e formazione culturale, incluse le persone con disabilità di vario tipo.

A ciò si aggiunge il fatto che talvolta questi CAPTCHA di nuova generazione chiedono di identificare oggetti o forme all’interno di immagini generate da intelligenze artificiali come Dall-E o Midjourney, con risultati molto bizzarri: ci si può trovare per esempio davanti alla richiesta di selezionare tutte le nuvole che hanno la forma di un cavallo, oppure di individuare oggetti che non esistono. Qualche mese fa un’azienda chiamata hCaptcha – che sta a sua volta lavorando molto sullo sviluppo di test di nuova generazione – ha chiesto per esempio di identificare uno “yoko”, ovvero una sorta di yo-yo a forma di lumaca, che però nel mondo reale non esiste.

«È probabile che in futuro le cose si faranno ancora più strane, che si chiederà alle persone di fare cose che non hanno alcun senso», dice Gosschalk. «Altrimenti le intelligenze artificiali saranno in grado di passare i test quanto gli esseri umani». L’idea è infatti quella di individuare dei test talmente specifici e bizzarri da richiedere un sacco di soldi e tempo per qualsiasi sviluppatore voglia cercare di circuirli con un bot. Secondo i loro calcoli, anche i test più complessi che sono stati per ora ideati da Arkose Labs vengono risolti al primo colpo da quasi tutti gli esseri umani (il 94,6 per cento, per l’esattezza). Alcune idee vengono però scartate molto presto, prima di essere sottoposte a un pubblico più ampio, perché vengono considerate troppo difficili.