Come ci sembra vera una faccia finta

I sistemi di intelligenza artificiale sono sempre più abili nel fare ritratti realistici di persone che non esistono: secondo una nuova ricerca ci ingannano facilmente

I recenti progressi nella produzione di immagini tramite sistemi di intelligenza artificiale (AI) hanno reso ancora più difficile distinguere le immagini reali da quelle di fantasia, soprattutto nel caso dei ritratti di persone. Una ricerca da poco pubblicata sulla rivista scientifica Psychological Science lo ha mostrato efficacemente, segnalando come i partecipanti allo studio abbiano indicato come reali i visi di persone che in realtà non esistono e che sono il frutto di un’elaborazione di uno dei sistemi di AI più noti per produrre immagini. Oltre ad aggiungere elementi al confronto sul ruolo delle AI nelle nostre esistenze, soprattutto in relazione alla diffusione di notizie false, la ricerca offre qualche spunto sul modo in cui riconosciamo i volti e decidiamo più o meno inconsapevolmente se siano convincenti a sufficienza da apparirci reali.

Il gruppo di ricerca ha selezionato 124 persone, tutte bianche (dopo vedremo perché), e ha mostrato loro 100 volti creati con uno dei più efficienti generatori di immagini (StyleGAN2) e altre 100 di vere persone, sempre bianche. Le immagini erano mischiate tra loro e ogni partecipante doveva indicare se si trattasse di una persona reale o creata dal computer. Se le risposte fossero state date a caso, sarebbero state giuste in media una volta su due, come avviene quando si lancia una moneta per fare “testa o croce”. Dal test è invece emerso che le persone segnalavano come reali le immagini dell’AI con una frequenza piuttosto alta. In media, 2 foto su 3 generate col sistema di intelligenza artificiale sono state indicate come appartenenti a veri esseri umani.

Il gruppo di ricerca segnala che per la maggior parte delle persone le facce prodotte da una AI appaiono più reali, o per lo meno realistiche, di quelle di persone che esistono veramente. L’esperimento ha inoltre mostrato che le persone non sono molto abili nel distinguere le immagini prodotte dai sistemi di intelligenza artificiale. Per capire come mai ciò accada, in una seconda fase dello studio è stato chiesto alle persone partecipanti il loro livello di sicurezza sulle scelte fatte. È risultato che le persone che avevano scambiato più immagini fatte dalle AI per reali erano anche quelle più sicure delle loro risposte.

La scelta di utilizzare solamente volontari e persone bianche nelle immagini è derivata dalla necessità di utilizzare ritratti che apparissero realistici, un risultato che molte AI non riescono a offrire perché riflettono alcuni pregiudizi legati al colore della pelle. Le grandi quantità di dati su cui i sistemi di intelligenza artificiale vengono formati contengono soprattutto immagini di persone bianche, molto più rappresentate rispetto alle altre. È un problema noto da tempo e che condiziona il modo in cui funzionano le AI, al punto da avere aperto un ampio dibattito sul rischio di avere pregiudizi basati sul colore della pelle in sistemi automatici.

Rifacendosi ai dati impiegati per un altro studio, il gruppo di ricerca ha provato a verificare le capacità di riconoscimento dei volontari con ritratti di persone nere o asiatiche, notando che a causa della minore resa realistica delle elaborazioni i partecipanti riuscivano a riconoscere una foto reale da una fasulla nella metà dei casi. I ritratti fatti dai sistemi di intelligenza artificiale di persone bianche appaiono quindi più realistici di quelli delle persone di colore, soprattutto perché il software riesce ad aggiungere piccoli dettagli e imperfezioni che rendono più credibili le immagini. Avendo maggiori basi di dati legate alle persone bianche, riescono a farlo meglio rispetto a quelle di colore, il cui incarnato risulta per esempio più liscio e meno realistico.

La capacità della nostra specie di riconoscere i volti è studiata da molto tempo sia dal punto di vista neurologico sia psicologico, grazie a test su persone sane e a quelli su persone con particolari condizioni neurologiche. Gli studi sulla prosopagnosia, una condizione che rende difficile se non impossibile il riconoscimento del viso delle persone, hanno per esempio aiutato a comprendere quali aree del cervello si attivano quando vediamo una faccia e la riconduciamo a una certa identità.

In condizioni normali, come esseri umani abbiamo una spiccata capacità di distinguere i volti e di identificarli in contesti complessi: dal cercare qualcuno che conosciamo in un’affollata stazione della metropolitana a vedere una persona nascosta tra le fronde di un albero. Con vari livelli di consapevolezza, sappiamo come è fatta una faccia e soprattutto che cosa potremo trovarci sopra, oltre ai suoi elementi più riconoscibili come il naso, gli occhi e la bocca. Ci aspettiamo che ci siano rughe di espressione, rigonfiamenti sotto gli occhi, peli della barba e lanugine, macchie e nei, aree dove la pelle è più secca e altre imperfezioni come brufoli e cicatrici. Ciascuno di questi elementi rende unica e riconoscibile una faccia e i sistemi di intelligenza artificiale lavorano proprio su questo, aggiungendo dettagli che rendano verosimili le loro immagini al punto da illudere la persona che le osserva.

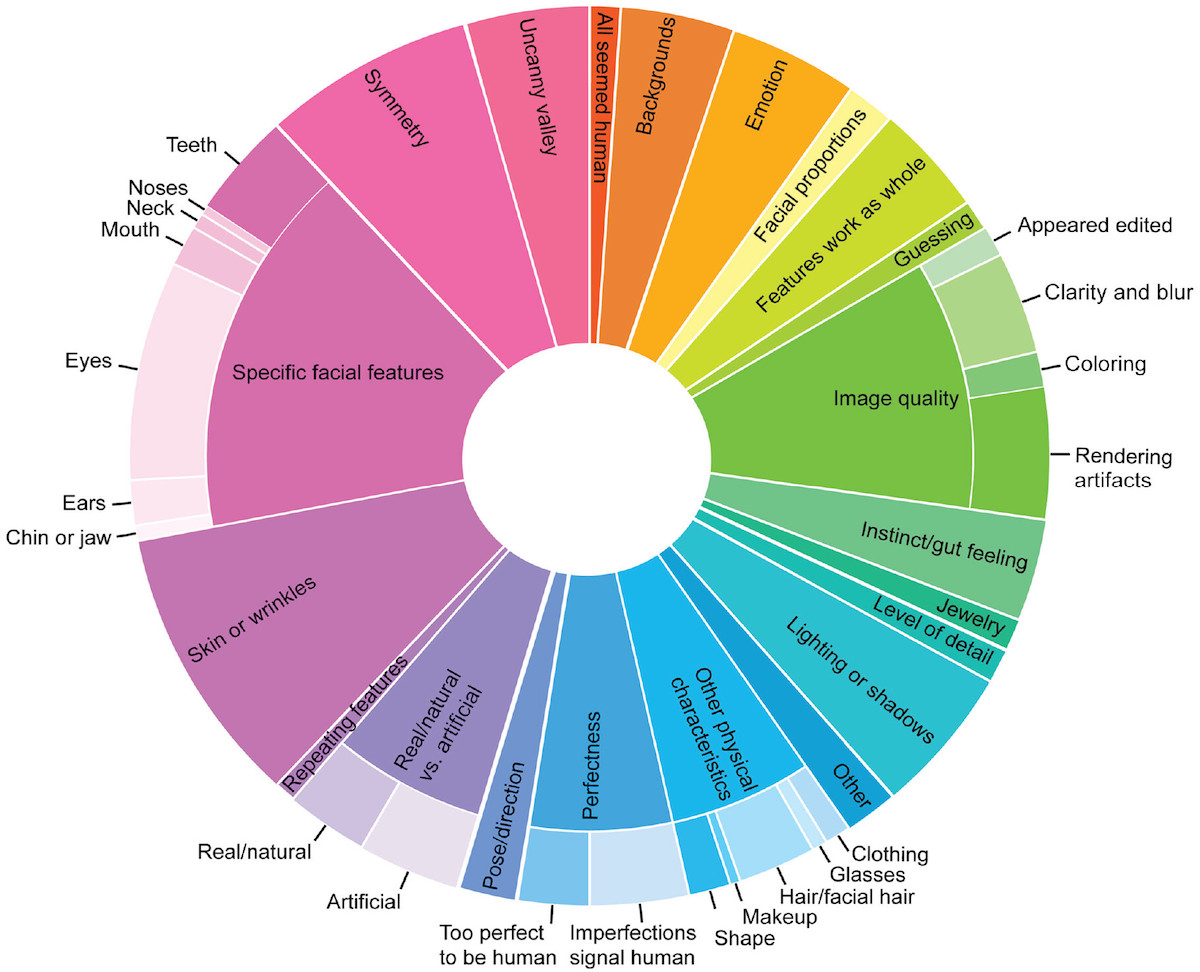

Fattori utilizzati nel determinare l’autenticità o meno dei ritratti (Psychological Science)

Lo studio definisce questo fenomeno “effetto iperrealismo” e segnala come le AI creino quasi sempre visi che appaiono quasi familiari perché neutri, una rappresentazione di una “faccia media” cui vengono poi aggiunti dettagli per renderla ancora più realistica. È facile trovare in quelle immagini tratti che conosciamo e che ci trasmettono qualcosa, con il risultato che troviamo più realistica la foto di qualcuno che non esiste rispetto a quella di una persona effettivamente esistente.

Dopo la pubblicazione, il gruppo di ricerca ha anche fatto alcuni test per verificare le capacità dei sistemi di intelligenza artificiale di riconoscere i visi reali da quelli disegnati dalle AI. Chi sviluppa queste soluzioni sostiene che siano il modo ideale per aiutare le persone a riconoscere un’immagine che non è reale, ma dalle prove effettuate è emerso che nella maggior parte dei casi i software di riconoscimento fallivano nel compito più o meno quanto i volontari della sperimentazione. In mancanza di sistemi adeguati in alcuni casi è quindi pressoché impossibile sapere se si stia osservando o meno la faccia di qualcuno che esiste nella realtà, con tutte le implicazioni del caso.

Le tecnologie legate alle AI sono in rapida evoluzione e in appena un anno molti dei loro sistemi sono migliorati moltissimo, soprattutto nella generazione di immagini. È difficile quindi prevedere quali potranno essere gli sviluppi di queste tecnologie e soprattutto degli strumenti per riconoscere i ritratti fasulli e non solo. È un problema con cui iniziano a confrontarsi anche i governi, con l’avvio di commissioni e di nuovi regolamenti, con la difficoltà di comprendere nelle leggi evoluzioni di un settore in piena espansione.

Soluzione

Prima riga: AI, AI, reale, AI.

Seconda riga: Reale, reale, AI, reale.