Perché le foto della Luna fatte con lo smartphone sono tremende

"No, ma ti assicuro che a occhio nudo era grandissima"

Samsung, la seconda azienda produttrice di smartphone al mondo, è stata accusata di falsificare le fotografie della Luna scattate da alcuni suoi modelli di telefoni, per farle apparire più definite rispetto alle foto mediamente scadenti che si riescono a scattare al cielo notturno con un cellulare. Come sa chiunque ci abbia provato, fare una foto alla Luna con uno smartphone è molto difficile e i risultati sono quasi sempre deludenti, a causa delle capacità limitate del telefono. Samsung è stata criticata per non avere reso esplicita l’esistenza del sistema di ritocco, dando l’impressione che sensori e ottiche dei propri smartphone fossero sufficienti per ottenere risultati migliori rispetto ai telefoni della concorrenza.

In generale, negli ultimi anni le fotocamere degli smartphone sono migliorate notevolmente sia in termini di definizione sia di ingrandimenti. I progressi sono stati resi possibili dall’impiego di sensori più grandi, di conseguenza in grado di ricevere una maggiore quantità di luce e di offrire immagini più definite. Al miglioramento dei sensori si è aggiunto l’impiego di lenti di vario tipo per gli obiettivi, sia per scattare fotografie a campo molto largo (grandangoli) sia per fare foto di oggetti distanti con un minimo di zoom (teleobiettivi).

Gli smartphone di maggiore qualità hanno spesso più di una fotocamera, con diversi set di lenti e sensori, in modo da rendere possibili varie impostazioni di scatto da vicino o da molto lontano. A seconda della dimensione del sensore, offrono inoltre la possibilità di scattare fotografie piuttosto nitide e non disturbate in scarse condizioni di luce, come può avvenire in un locale poco illuminato o all’aperto di notte.

Nonostante questi miglioramenti, le fotografie al cielo notturno continuano a essere problematiche perché i corpi celesti sono molto distanti e relativamente poco luminosi, quindi difficilmente la loro luce viene colta correttamente dai sensori degli smartphone, troppo piccoli se confrontati con quelli delle classiche fotocamere. La Luna fa lievemente eccezione perché per quanto distante appare comunque molto luminosa, specialmente quando è piena.

Nelle notti limpide, la Luna illumina la volta celeste e a causa di alcuni effetti ottici può apparirci molto più grande di quanto in realtà non sia in cielo, per esempio se ha vicino qualcosa all’orizzonte come alcuni edifici o le fronde di un albero. È di solito in queste occasioni che proviamo a scattare una fotografia del nostro satellite naturale perché sembra così vicino. Ma basta inquadrarlo per vedere un piccolo puntino luminoso sullo schermo e accorgersi dell’illusione prospettica.

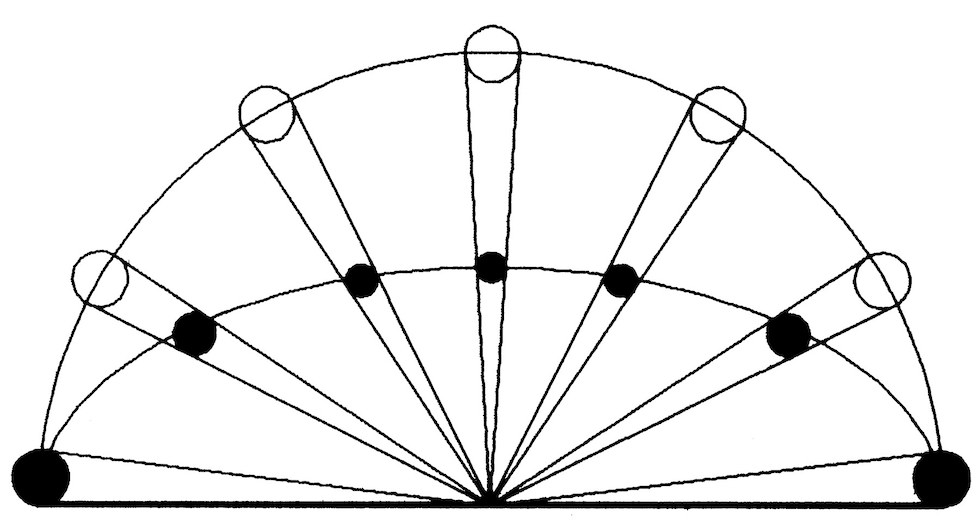

Rappresentazione della Luna nel suo moto lungo la volta celeste (cerchi bianchi) sempre alla stessa distanza da un osservatore, e di come appare a quell’osservatore per questioni prospettiche (cerchi neri) – NASA

Se lo smartphone è dotato di zoom ottico, cioè di lenti che permettono un certo numero di ingrandimenti, si può risolvere in parte il problema. Nel caso in cui l’unico zoom disponibile sia quello digitale, che di fatto ingrandisce l’immagine che già vediamo sullo schermo, il risultato finale è di scarsa qualità al punto da rendere appena intuibile che quel disco luminoso sia la Luna.

La Luna fotografata di notte con un iPhone 7

Non è comunque un solo problema di ottica, ma anche di esposizione. Nella sua impostazione automatica, la fotocamera dello smartphone prova a cercare il giusto equilibrio tra la fonte di luce, in questo caso la Luna, e ciò che ha intorno, cioè il cielo. Ciò deriva da alcuni vincoli legati al sensore, ma anche dal software che fa funzionare l’applicazione della fotocamera.

Se invece di inquadrare il cielo con la Luna state inquadrando una lampadina con una scena di qualche tipo sullo sfondo, ha senso che il telefono cerchi di mostrare anche cosa c’è oltre la lampadina, aumentando la luminosità della parte più buia dell’inquadratura. Nel caso della Luna un’impostazione di questo tipo non porta ad alcun beneficio, con il risultato che la superficie lunare appare estremamente luminosa e senza alcun dettaglio.

Per rendere visibile qualche dettaglio si deve intervenire manualmente sulle impostazioni della fotocamera, riducendo per esempio l’esposizione. Sulla maggior parte degli smartphone per farlo è sufficiente inquadrare la Luna, toccare il punto dello schermo dove questa appare e poi muovere il dito verso il basso, in modo da ridurre l’esposizione. Il cielo diventa sempre più scuro e, compatibilmente alle capacità dello smartphone e del suo sensore, alcune asperità del suolo lunare – come i crateri – iniziano ad apparire. Occorre poi avere una mano ferma per scattare la foto evitando che venga mossa, specialmente se si sta utilizzando lo zoom, che amplifica ogni minimo movimento.

Le applicazioni degli smartphone più recenti hanno spesso sistemi per il riconoscimento automatico delle inquadrature, in modo da distinguere un panorama da un ritratto e utilizzare le migliori impostazioni per lo scatto. Alcune hanno una funzionalità anche per il cielo notturno, che rende più semplice la fotografia della Luna e degli altri corpi celesti, senza dover intervenire manualmente sulle impostazioni della fotocamera. Il risultato finale è di solito accettabile, anche se incomparabile con quello che si può ottenere con una macchina fotografica dotata di un buon teleobiettivo.

La Luna fotografata con un teleobiettivo di una fotocamera professionale (Dan Kitwood/Getty Images)

Ultimamente alcuni produttori di smartphone hanno introdotto quelli che chiamano “sistemi di intelligenza artificiale”, per migliorare le capacità di ingrandimento delle foto scattate dai loro dispositivi. La maggior parte di questi algoritmi viene applicata subito dopo lo scatto della fotografia ed è una sorta di Photoshop istantaneo, per migliorare il bilanciamento della luce e dei colori, oppure per rendere più nitidi gli scatti nel caso in cui si sia utilizzato lo zoom.

I recenti Pixel 7 Pro di Google, per esempio, hanno un teleobiettivo fino a 5 ingrandimenti, ma sfruttano vari algoritmi per ottenere uno zoom realistico fino a 30 ingrandimenti. Il sistema riesce a riconoscere gli oggetti nell’inquadratura e di conseguenza li migliora, ricostruendo le parti mancanti o che appaiono sgranate nell’immagine di partenza. In alcuni casi il risultato è molto realistico, in altri è più confuso, specialmente nel caso di oggetti molto distanti o fotografati in condizioni di luce poco favorevoli, per esempio in un giorno con molta foschia o a causa di un controluce.

La capacità di ingrandimento del Pixel 7 Pro (Google)

Samsung ha ricevuto la proprie critiche per una soluzione simile a quella sviluppata da Google, presente nel suo nuovo Galaxy S23 Ultra, ma dedicata specificamente a fotografare la Luna. In questo caso gli algoritmi intervengono molto più pesantemente, come ha dimostrato un utente su Reddit portando poi alle numerose critiche nei confronti di Samsung.

Il telefono è stato messo alla prova fotografando uno schermo di un computer sul quale era mostrata una fotografia molto sfocata e poco definita della Luna.

https://imgur.com/ifIHr3S

Dopo avere scattato la fotografia, lo smartphone ha riconosciuto che si trattava della Luna e ha aggiunto vari dettagli per rendere più definita e verosimile l’immagine.

https://imgur.com/bXJOZgI

La fotografia risultante è chiaramente una cosa diversa da ciò che era stato inquadrato e questo varrebbe anche nel caso di un normale scatto verso il cielo notturno, illuminato dalla Luna. Le immagini sono circolate molto online e hanno rinfocolato un dibattito ormai annoso sulla funzione sviluppata da Samsung per correggere le fotografie di quel tipo.

La società ha risposto alle critiche con una spiegazione piuttosto generica sul funzionamento degli algoritmi per migliorare le fotografie della Luna, sostenendo che riconosca i contorni e alcune forme per poi migliorarne l’aspetto. Molti utenti hanno però segnalato che gli algoritmi fanno qualcosa di più, creando dettagli che non esistono nemmeno nella realtà. La Luna a distanza qui sulla Terra ci sembra sempre più o meno uguale, di conseguenza un’immagine che approssimi le sue caratteristiche non ci sembra strana ed è probabilmente preferibile a un’immagine sfocata e poco definita, o almeno è come la pensa Samsung a giudicare dal grande rilievo dato alla funzione anche nelle sue pubblicità.

Un fotogramma della pubblicità del Samsung Galaxy S23 Ultra

La maggior parte delle foto che vediamo su Instagram o persino in una esposizione di fotografia non sono necessariamente “vere”, sono state modificate per migliorarne l’esposizione o per mettere in evidenza qualche dettaglio, oppure ancora per nasconderne o cancellarne altri. Lo si faceva ancora prima dell’avvento del digitale, anche se nella camera oscura era più difficile farlo e c’erano maggiori limiti. Stabilire quale sia il confine tra un’immagine “vera” e una “falsa” e chi lo abbia o meno valicato è molto difficile, anche nel caso in cui sia un algoritmo a intervenire per rendere meno scadenti e frustranti le foto alla Luna, che facciamo tutti.

– Leggi anche: Come abbiamo fotografato la Luna, sulla Luna