I sistemi di riconoscimento facciale stanno arrivando nelle città italiane

Torino, Como e Udine hanno già approvato i progetti, nonostante i rischi e il fatto che al momento non siano tecnicamente legali

di Isaia Invernizzi

Raggiungere il centro di Udine a piedi, partendo dalla stazione ferroviaria, è piuttosto semplice: Google Maps consiglia di camminare in via Roma, una strada a senso unico con molti negozi, qualche dehors, e due file di magnolie che danno il nome al quartiere. Come in tutte le zone vicino alle stazioni, anche nel quartiere delle Magnolie si possono incontrare persone con problemi di alcol o senza una casa. Negli ultimi anni ci sono stati alcuni arresti legati allo spaccio di droga e chi abita qui ha chiesto più volte al comune di intervenire per garantire più sicurezza.

La soluzione trovata coinvolgerà chiunque camminerà in via Roma e in tante altre strade di Udine: tutti saranno osservati, seguiti e identificati dalle telecamere per il riconoscimento facciale, che il comune vuole attivare nei prossimi mesi. Potenzialmente si potranno acquisire i dati biometrici – le caratteristiche fisiche che consentono di identificare una faccia – di migliaia di persone ogni giorno: secondo il Garante della privacy, che ha già fermato un progetto simile, questa tecnologia rappresenta una premessa per la sorveglianza di massa.

Il caso di Udine non è isolato, e secondo gli esperti del tema le modalità con cui progetti del genere sono stati proposti e valutati in diverse città italiane suggeriscono una generale sottovalutazione dei rischi della videosorveglianza e del riconoscimento facciale. Il problema, segnalato da tempo da attivisti ed esperti di tecnologie, è che si tratta di sistemi estremamente invasivi in termini di privacy, eppure poco o niente regolati: si sa poco di come funzionano, di come vengono raccolti e usati i dati, di quali sono i limiti e gli obiettivi. Sono strumenti potenti e più simili a quelli utilizzati dalle forze dell’ordine e della magistratura, che però vorrebbero essere gestiti in molti casi dalle amministrazioni pubbliche, che non hanno normalmente queste competenze e questi poteri.

Dall’inizio degli anni Duemila nei comuni italiani sono stati installati migliaia di sistemi di videosorveglianza controllati dalla polizia locale. Dagli schermi, nelle nuove sale operative, si può spesso controllare quasi ogni angolo delle città grazie alle telecamere posizionate sui pali della luce e sulle facciate degli edifici. Rispetto alle prime versioni, ingombranti e piuttosto visibili, le telecamere sono sempre più piccole, sofisticate, e sono sempre di più. Per installarle sono stati spesi milioni di euro in nome della cosiddetta “sicurezza percepita”. Nonostante gli investimenti non è cambiato molto, perché la percezione di insicurezza è qualcosa di soggettivo: gli appelli e le lamentele delle persone che abitano nelle zone considerate insicure non si sono fermati sia nelle grandi città come Milano, sia in quelle più piccole.

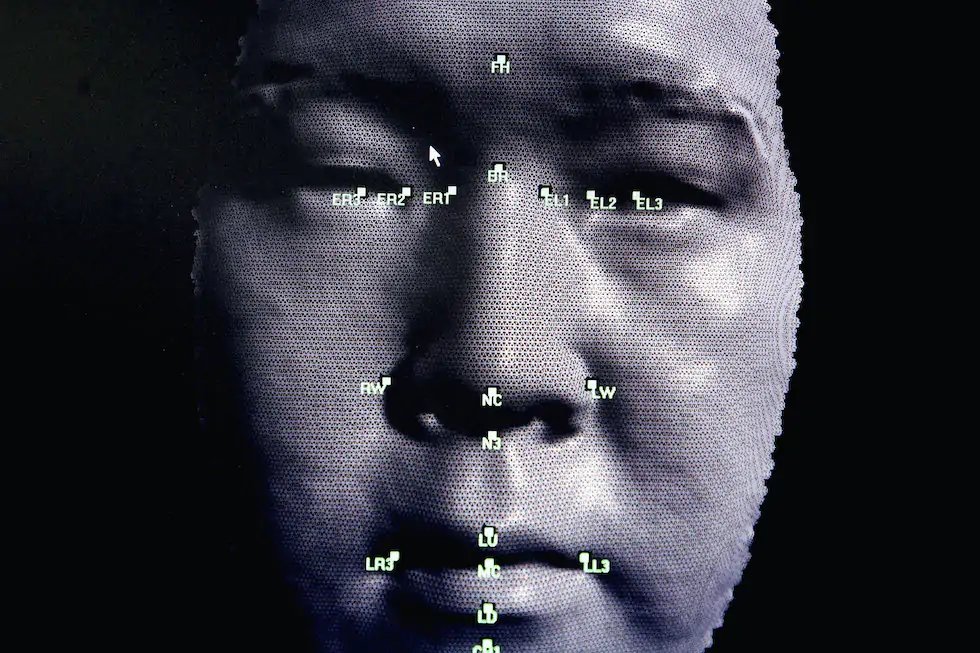

Ma seppure identiche nella forma, le telecamere di Udine non sono come quelle a cui siamo abituati: sono dotate di una tecnologia che consente di acquisire, sempre e in tempo reale, i dati biometrici delle persone come la fisionomia del volto, il colore degli occhi, la distanza tra le pupille, la grandezza del naso e della bocca. Si chiama riconoscimento facciale: un software analizza l’immagine della persona sotto forma di pixel, di dati, da cui trae un modello matematico che viene poi applicato ad altre immagini per trovare una corrispondenza. L’archivio delle immagini è essenziale per identificare una persona e viene alimentato dai dati di tutte le persone che camminano per strada, rilevate costantemente dalle telecamere. Alcuni software evoluti sono in grado di identificare una persona anche analizzando la sua andatura.

Gli algoritmi utilizzati dai sistemi di riconoscimento facciale sono molto efficienti. Il problema sono i dati con cui vengono addestrati. Secondo il NIST, il National Institute of Standard and Technology, un organo governativo americano che studia algoritmi di riconoscimento facciale, la maggior parte dei software tende a essere più accurata quando si tratta di riconoscere volti di maschi bianchi rispetto alle persone nere o alle donne. Gli errori sono causati dai database di riferimento, che spesso sono costituiti da milioni di immagini pubblicamente disponibili attraverso i social network. A seconda della composizione del database, varia la precisione: un database che raccoglie soprattutto volti di maschi e di persone bianche renderà il software più allenato a riconoscere quelli.

Una possibile conseguenza è che qualcuno sia fermato, arrestato o indagato ingiustamente a causa di uno scambio di persona, risultato di un errore dell’algoritmo solo apparentemente infallibile.

Nella delibera del progetto del comune di Udine, che costerà 673mila euro, si legge che le 67 nuove telecamere serviranno a «generare automaticamente allarmi e segnalare in tempo reale la presenza di eventuali individui segnalati» e anche a identificare la loro presenza a posteriori, grazie alle registrazioni. Se posizionate a un’altezza di un metro e mezzo, negli arredi urbani come vasi o cestini, potranno identificare le persone «anche con occlusioni parziali del viso, occhiali, sciarpe, cappellini, cambiamenti di espressione, ombre, contrasti elevati e condizioni di luce estreme o scarse e sulle rotazioni moderate del volto». Tra le altre cose, si legge che le telecamere verificheranno la presenza di «individui sospetti», senza chiarire per ora in base a quali caratteristiche verranno considerati tali.

L’assessore alla Sicurezza, Alessandro Ciani, dice che i lavori di installazione inizieranno entro la fine dell’anno, spiegando che è un modo per dare una risposta agli abitanti del quartiere delle Magnolie che chiedono più sicurezza. Il riconoscimento facciale potrà essere utilizzato dalla polizia di stato, dai carabinieri e anche dalla polizia locale. I dati serviranno per le indagini di polizia giudiziaria e per il controllo del territorio in tempo reale, anche durante le manifestazioni. «Perché dovrei preoccuparmi se una telecamera conosce il mio nome e cognome o se un agente della polizia di stato sa che sono passato a quell’ora e in quella via? Chi viola la legge deve preoccuparsi, gli altri no», dice Ciani al Post. «Mi auguro che i problemi di autorizzazione legati alla privacy siano risolti presto».

Nei documenti del comune si trovano informazioni piuttosto dettagliate sulle telecamere, mentre non ci sono le specifiche del software che verrà utilizzato per analizzare i dati. Questo perché al momento, in realtà, il riconoscimento facciale attraverso i sistemi di videosorveglianza pubblici è illegale dopo un provvedimento del Garante della privacy che il 26 febbraio 2020 intervenne per fermare un progetto del comune di Como. Ciononostante, il comune di Udine intende installare il sistema, in attesa che le cose cambino.

Per contesto, modalità e obiettivi, il caso di Como era identico a quello di Udine: il comune aveva installato telecamere per il riconoscimento facciale nel parco di via Tokamachi, vicino alla stazione. È una zona che nel 2016 aveva ospitato centinaia di migranti diretti verso il Nord Europa e bloccati a Como dalla chiusura del confine con la Svizzera.

Il Garante spiegò che l’acquisizione e il trattamento dei dati biometrici non aveva basi giuridiche valide, e quel parere è ancora valido. La sperimentazione di Como, poi bloccata, venne svelata da un’inchiesta di Laura Carrer, Riccardo Coluccini e Philip Di Salvo, tre giornalisti e attivisti dei diritti digitali che negli ultimi anni hanno monitorato le amministrazioni che investono fondi pubblici nei sistemi di riconoscimento facciale, spesso senza essere davvero consapevoli delle possibili conseguenze sulla vita delle persone.

È un tema che interessa anche la campagna elettorale delle elezioni amministrative in programma il 3 e il 4 ottobre. A Roma, il candidato sindaco di Azione Carlo Calenda ha proposto di installare seimila nuove telecamere nelle strade della Capitale in aggiunta alle 1.300 già esistenti. In una lettera sul tema della sicurezza – l’intervento inizia dicendo che Roma ha meno crimini di Milano, Torino, Napoli, Firenze e Venezia in rapporto alla popolazione – Calenda ha scritto di voler mettere a disposizione delle forze dell’ordine «i flussi video delle telecamere private e pubbliche» e di voler installare «telecamere intelligenti nei luoghi più sensibili della città».

A Torino, invece, è già stato finanziato il progetto Argo, che consiste nell’attivazione di dieci telecamere, che dovrebbero diventare 275, e che permetteranno di identificare in tempo reale le persone. Secondo il comune, questo sistema sarà in grado di prevedere i comportamenti e gli spostamenti di gruppi di persone, come nel caso di manifestazioni o proteste.

Negli ultimi anni associazioni come Privacy Network e il Centro Hermes hanno organizzato diverse campagne per sensibilizzare le persone sui rischi del riconoscimento facciale e hanno chiesto alle istituzioni europee e italiane di vietare la sorveglianza di massa attraverso sistemi come la videosorveglianza nelle città. Privacy Network si è occupata anche del progetto di Udine attraverso diverse richieste di accesso ai documenti del comune. «Non c’è nessuna garanzia sulla custodia dei dati biometrici, non c’è una valutazione sull’uso dei dati dei cittadini, non c’è una valutazione d’impatto che giustifichi l’uso di questi dati», dice Matteo Navacci, attivista di Privacy Network. «Il sindaco e gli assessori hanno detto che questa rete servirà ad aumentare la percezione della sicurezza, sottovalutando quanto sia invasivo questo sistema».

Secondo Diletta Huyskes, responsabile del dipartimento Advocacy di Privacy Network, un altro grande limite dei progetti di videosorveglianza delle città è la mancanza di un consenso e di consapevolezza da parte delle persone. Huyskes spiega che spesso a Udine, come era già successo a Como e in altre parti del mondo, queste telecamere vengono installate senza spiegare ai cittadini che verranno schedati e che i loro dati potranno essere utilizzati anche in futuro. «Una volta che vengono archiviati rimangono in un database e possono essere usati anche per scopi diversi», dice. «In nome della sicurezza, e senza la certezza che questi strumenti siano davvero affidabili, si sottovalutano gli enormi rischi per la privacy: ne vale davvero la pena?»

Le associazioni per i diritti digitali sostengono che il riconoscimento facciale sia assimilabile alle intercettazioni per la specificità della sorveglianza: la legge italiana ha disciplinato l’uso delle intercettazioni, autorizzate solo se ci sono gravi indizi di reato o se sono assolutamente indispensabili per le indagini della magistratura. La sorveglianza biometrica invece è preventiva, e consente di monitorare chiunque: persone che non sono indagate e anche chi sta esercitando il diritto di manifestare. Il riconoscimento facciale, per esempio, è stato usato per sopprimere le proteste di Hong Kong tra il 2019 e il 2020.

I principi che muovono queste associazioni sono piuttosto simili: la privacy è intesa come diritto alla riservatezza, e considerata uno spazio senza il quale non possono essere garantite davvero le libertà fondamentali, dalla libertà di espressione a quella di movimento.

Il Garante della privacy la pensa allo stesso modo. Durante un seminario organizzato a inizio giugno dall’associazione Privacy Italia, Agostino Ghiglia, componente del collegio del Garante della privacy, ha spiegato che il riconoscimento facciale può essere uno «strumento di indagine o di persecuzione». Griglia ha detto che le telecamere di nuova generazione sono in grado di interpretare qualsiasi movimento del volto o una piccola alterazione della pupilla, che i sistemi consentono di seguire costantemente una persona e archiviare tutti i suoi movimenti: «È la base della sorveglianza di massa».

Il Garante della privacy ha già bloccato il progetto della videosorveglianza a Como ed è intenzionato a fermare gli altri tentativi di attivare il riconoscimento facciale nelle città. I comuni, in particolare, dovrebbero secondo il Garante considerare con attenzione il principio di proporzionalità tra il potere della videosorveglianza e gli obiettivi di un’amministrazione. «Ognuno deve fare il suo mestiere: la magistratura ha un compito, le forze di sicurezza un altro, i comuni un altro ancora. Un comune non può avere poteri paragonabili a quelli della magistratura, non può fare indagini», ha detto Ghiglia. «Questo deve essere chiaro, altrimenti si apre una voragine».

Lo scorso marzo il Garante della privacy ha dato un parere negativo sulla funzione “real time” del sistema chiamato SARI Enterprise, utilizzato dalle forze dell’ordine italiane per identificare una persona confrontando i suoi dati biometrici con le immagini di tutti gli individui già fotosegnalati. Di SARI “real time” si sa poco: non si sa come funziona l’algoritmo e cosa decide. Nel parere negativo si legge che questo sistema «oltre ad essere privo di una base giuridica che legittimi il trattamento automatizzato dei dati biometrici per il riconoscimento facciale a fini di sicurezza, realizzerebbe per come è progettato una forma di sorveglianza indiscriminata/di massa».

In aprile è stata pubblicata la bozza di regolamento per l’intelligenza artificiale proposta dalla Commissione europea. Tra le altre cose, dice che il riconoscimento facciale negli spazi pubblici è proibito, ma lascia aperte alcune possibilità: può essere utilizzato per la ricerca di vittime di un reato o nel caso della ricerca di bambini scomparsi, per prevenire attacchi terroristici e per individuare i criminali, senza però spiegare con precisione quali siano i limiti di utilizzo da parte delle forze dell’ordine. In Italia, il deputato del Partito Democratico Filippo Sensi ha proposto una moratoria temporanea, fino al 31 dicembre 2021, per vietare l’utilizzo dei sistemi di videosorveglianza biometrici nei luoghi pubblici in attesa che il Parlamento discuta una legge.

È difficile prevedere quando il regolamento europeo sarà approvato e soprattutto come verrà applicato dai singoli stati dell’Unione Europea. Secondo molti esperti, queste regole non bastano: il 21 giugno il Comitato europeo per la protezione dei dati (EDPB) e il Garante europeo della protezione dei dati (EDPS) hanno chiesto alla Commissione europea di vietare qualsiasi uso delle sorveglianze biometriche negli spazi pubblici, sostenendo che mettono a rischio i diritti e le libertà.

La stessa richiesta era stata presentata dalla campagna Reclaim Your Face, organizzata da molte associazioni europee tra cui il Centro Hermes. Al momento sono state raccolte 60mila firme in tutta Europa. Laura Carrer, giornalista e attivista dei diritti digitali, dice che vietare il riconoscimento facciale è un obiettivo molto ambizioso, perché quello dell’intelligenza artificiale è un mercato potente e in evoluzione, da cui l’Europa difficilmente sarà esclusa. Anche secondo Carrer la regole previste nella bozza del regolamento europeo non bastano. «È importante rendere consapevoli le persone dei rischi di questa tecnologia: le regole ci sono, ma con diverse eccezioni», spiega. «Chi ci dice come la polizia utilizzerà la sorveglianza biometrica? Non ci sono garanzie: purtroppo manca un processo di trasparenza nei confronti dei cittadini su come viene utilizzato il riconoscimento facciale e per cosa viene utilizzato».