Come l’Europa vuole regolamentare le intelligenze artificiali

La Commissione Europea ha presentato una proposta molto articolata e ambiziosa sulle tecnologie al centro del nostro futuro

Mercoledì 21 aprile, la Commissione Europea ha presentato un’articolata proposta per la regolamentazione dell’utilizzo dei sistemi di intelligenza artificiale (AI), con lo scopo di indicarne gli usi consentiti e quelli proibiti per tutelare la privacy e altri diritti dei cittadini europei. La proposta era piuttosto attesa ed è considerata il progetto più ambizioso finora realizzato per regolamentare un settore in piena espansione e dai contorni ancora sfumati. Per entrare in vigore, il nuovo regolamento dovrà essere discusso e votato dal Parlamento Europeo e dagli stati membri, processo che richiederà alcuni anni per essere completato.

L’iniziativa della Commissione copre diversi ambiti e applicazioni della AI, dai sistemi per le nuove assunzioni di personale nelle aziende agli algoritmi che fanno funzionare le automobili a guida autonoma, passando per il riconoscimento facciale da parte delle forze dell’ordine. Il regolamento stabilisce che cosa si può e che cosa non è consentito fare con le AI e prevede multe fino al 6 per cento del fatturato annuo delle aziende coinvolte, con meccanismi simili a quelli impiegati per il GDPR, il regolamento per la tutela della privacy in vigore da qualche anno nell’Unione Europea.

Riconoscimento facciale

Uno dei temi centrali, e già ampiamente discussi prima che la proposta fosse presentata ufficialmente, è legato ai sistemi per riconoscere automaticamente gli individui nelle riprese delle telecamere di sicurezza. La proposta prevede che sia vietato in generale l’utilizzo «in tempo reale» di questi sistemi negli spazi pubblici anche se a scopo di attività condotte dalle forze dell’ordine. Il regolamento prevede però numerose eccezioni, compresa la possibilità di ricorrere al riconoscimento facciale per la ricerca da parte della polizia di sospetti in attività criminali.

Per quest’ultimo caso è citata la necessità di avere un’autorizzazione da parte delle autorità giudiziarie, requisito che secondo diversi critici non costituirà un deterrente per evitare un ricorso eccessivo al riconoscimento facciale. È raro che non siano accordati permessi per svolgere attività di questo tipo, soprattutto se in condizioni di emergenza e quando si rende necessaria la ricerca di una o più persone sospettate di un crimine.

(AP Photo/Eric Risberg)

Come era stato segnalato nei mesi scorsi quando erano emerse anticipazioni del testo, il nuovo regolamento sembra mantenere una posizione poco netta nei confronti di tecnologie che potrebbero violare i diritti alla riservatezza dei cittadini. Se da un lato ne vieta l’utilizzo segnalandone i rischi, dall’altro prevede varie eccezioni che di fatto consentiranno alle forze di polizia di effettuare attività di sorveglianza di massa, senza molte garanzie sul trattamento dei dati.

Il divieto parla inoltre di attività di sorveglianza “in tempo reale”, cosa che sembra indicare che sia sempre consentito effettuare ricerche con tecnologie per il riconoscimento facciale su immagini già acquisite. Se così fosse, i singoli stati membri potrebbero utilizzare soluzioni tecnologiche già disponibili da qualche tempo e sempre più impiegate negli Stati Uniti e in Cina.

Altri divieti

Il regolamento prevede altri divieti nell’uso delle AI, per esempio non sarà consentito utilizzare tecnologie per calcolare il «punteggio sociale» di ogni individuo, una pratica sempre più sperimentata in Cina dove a ogni cittadino vengono assegnati punti in base ai comportamenti, che danno la possibilità di accedere a particolari servizi preclusi a chi abbia punteggi bassi.

Sarà inoltre vietato sviluppare algoritmi che possano causare danni fisici o psicologici agli individui, o con la capacità di manipolarne i comportamenti anche in forma subliminale.

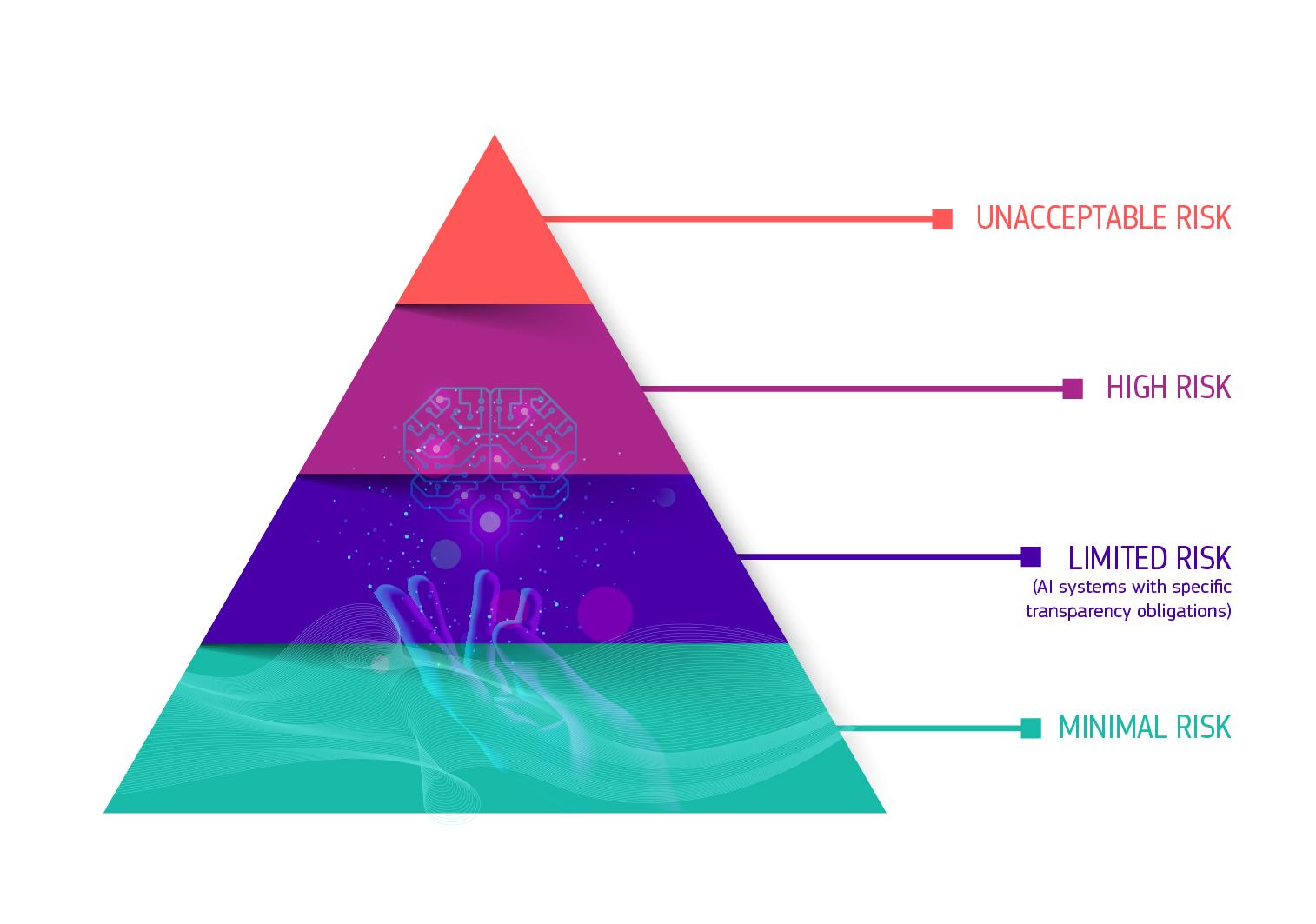

Scala del rischio

Le AI sono comunque già impiegate in numerosi ambiti e portano a innumerevoli benefici, sui quali la Commissione non è intenzionata a intervenire. Il regolamento identifica diversi livelli di rischio per queste tecnologie, segnalando che cosa debbano fare le aziende per poterle utilizzare senza incappare in multe e altre penalizzazioni.

(Commissione Europea)

Nel livello di rischio più basso sono compresi sistemi come i filtri contro le email o le telefonate indesiderate, per i quali non sono ravvisati particolari problemi, salvo loro evoluzioni da valutare in futuro. Il livello successivo comprende tecnologie a «rischio limitato» come i sistemi di risposta automatica per fornire assistenza online, per esempio per prenotare un volo o una visita medica, sui quali sarà necessario un controllo più attento perché implicano comunque l’impiego di dati personali.

Il terzo livello, quello ad «alto rischio», comprende invece le tecnologie che hanno un diretto e tangibile impatto sulla popolazione, e che sfuggono al controllo dei singoli. È un ambito sterminato e in costante crescita, che va dagli algoritmi per determinare chi possa accedere a un prestito al controllo e previsione delle transazioni digitali, passando per i sistemi che gestiscono la guida autonoma dei veicoli o i dispositivi medici.

Controlli

Per questi sistemi, la Commissione ha previsto diversi livelli di controllo per garantire la privacy e gli altri diritti della popolazione. Il regolamento richiede che le AI siano formate utilizzando dati che non contengano pregiudizi (per esempio di genere o legati alla provenienza geografica), che abbiano sistemi di controllo facilmente accessibili da parte degli esseri umani e che il loro funzionamento sia descritto in modo dettagliato e chiaro alle autorità competenti, e in modo comprensibile anche agli utenti.

La proposta contiene inoltre la creazione di una sorta di registro europeo delle intelligenze artificiali ad alto rischio, accessibile a tutti e con informazioni sulle caratteristiche delle varie AI sviluppate e impiegate dalle aziende private, pubbliche e dalle istituzioni. L’idea è stata accolta favorevolmente dagli osservatori, perché dovrebbe incentivare la trasparenza.

Terza via

Presentando il progetto la commissaria europea per l’Agenda digitale, Margrethe Vestager, ha spiegato che l’iniziativa europea cerca di distinguersi dalle esperienze portate avanti finora negli Stati Uniti e in Cina. Questa “terza via” europea mira a realizzare una legislazione che copra tutti i principali aspetti delle tecnologie che, nel bene e nel male, saranno al centro degli sviluppi dei prossimi decenni.

Margrethe Vestager (AP Photo/Francisco Seco)

Questa impostazione non incontra però i favori degli Stati Uniti, che avrebbero voluto uno sforzo più coordinato, soprattutto per contrastare i rapidi progressi nel settore della Cina. L’approccio statunitense ha però previsto finora l’adozione di poche regole, lasciando alle grandi aziende tecnologiche la responsabilità di organizzarsi per sviluppare soluzioni che rispettino i diritti e le leggi che li tutelano. Un approccio simile è stato seguito anche in ambito della privacy, segnando una forte differenza tra le regole previste negli Stati Uniti rispetto a quelle molto più severe comprese nel GDPR europeo.

Vincere la concorrenza delle grandi aziende statunitensi come Google, Amazon, Apple e Facebook non sarà comunque semplice, soprattutto perché queste società possiedono gigantesche quantità di dati, essenziali per istruire le intelligenze artificiali (machine e deep learning).

Secondo i detrattori, il nuovo regolamento europeo sulle AI potrebbe disincentivare le aziende a sviluppare le loro tecnologie nell’Unione Europea, proprio per la presenza di eccessivi vincoli. La Commissione prevede comunque di investire circa un miliardo di euro all’anno per incentivare iniziative e programmi legati alla digitalizzazione, finanziando aziende e startup del settore. Il piano prevede di attrarre investimenti fino a 20 miliardi di euro entro la fine del decennio nel settore.